Si estás leyendo sobre modelos de lenguaje grandes (LLM), seguramente ya has usado algún chat de IA tipo ChatGPT, Gemini o similares y te preguntas:

- ¿Qué hay “debajo” de ese chat?

- ¿Qué es exactamente un LLM?

- ¿En qué se diferencia de la inteligencia artificial “en general”?

En este artículo vamos a bajar a tierra el concepto: qué es un LLM, cómo funciona, para qué sirve y qué limitaciones tiene, explicado en humano.

Si quieres tener primero la foto general de la IA, te recomiendo empezar por aquí: Qué es la inteligencia artificial.

1. Qué es un modelo de lenguaje grande (LLM)

Un modelo de lenguaje grande (LLM, por sus siglas en inglés) es un modelo de inteligencia artificial entrenado para hacer una cosa muy concreta:

Predecir la siguiente palabra (o token) más probable dado todo el texto que ha visto antes.

Eso, que suena simple, permite que el modelo:

- Responda preguntas en lenguaje natural.

- Genere textos largos y coherentes.

- Resuma documentos.

- Traducca entre idiomas.

- Explique conceptos, escriba código, haga guiones, etc.

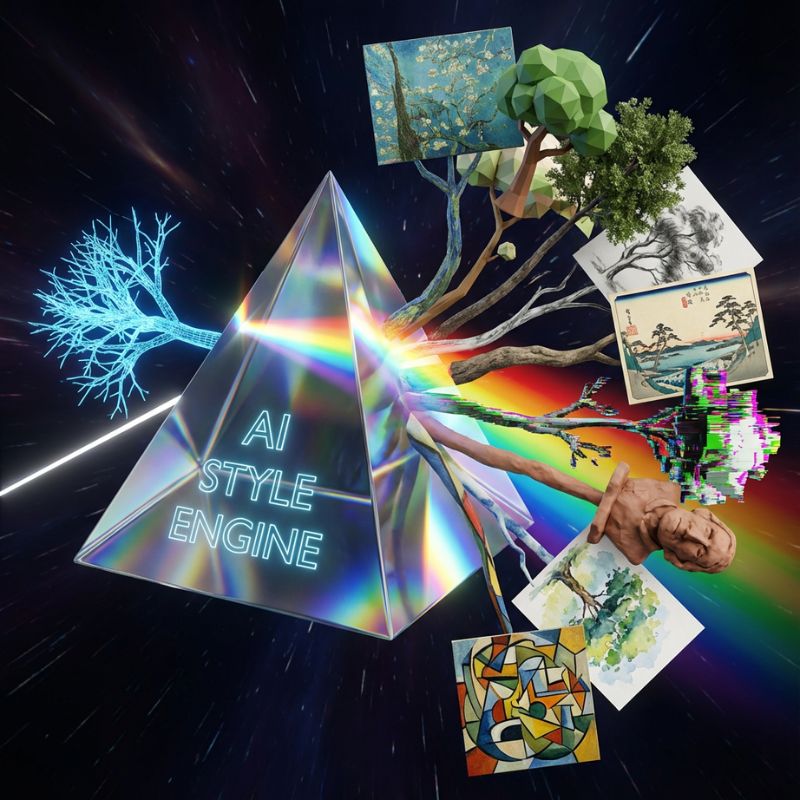

Un LLM no es una app ni un chat. Es el motor de lenguaje que muchas apps usan por debajo. El chat de IA que ves en pantalla es solo la capa de interfaz.

Si quieres ver la diferencia entre modelo y aplicación con más detalle, lo explicamos aquí: Modelos de inteligencia artificial.

2. De qué están hechos los LLM

Por dentro, los LLM combinan tres ingredientes clave:

- Datos de texto a gran escala (libros, webs, código, documentación…).

- Arquitectura Transformer, que es la estructura matemática que usan para procesar el lenguaje.

- Millones o miles de millones de parámetros, que son los “números internos” que el modelo ajusta durante el entrenamiento.

La arquitectura Transformer fue el gran salto en 2017 y es la base de la mayoría de LLM modernos.

Si quieres entender qué es un Transformer sin morirte de aburrimiento, lo hemos explicado aquí: Qué es un modelo Transformer.

3. Cómo se entrena un LLM (versión entendible)

Entrenar un LLM es, básicamente, esto:

- Coges cantidades gigantescas de texto.

- Se lo das al modelo troceado en secuencias.

- El modelo intenta predecir la siguiente palabra.

- Se equivoca → se corrige internamente.

- Repite ese ciclo miles de millones de veces.

Durante este proceso, el modelo no “memoriza textos” tal cual, sino que aprende patrones estadísticos del lenguaje:

- Qué palabras suelen ir juntas.

- Qué estructuras de frase son habituales.

- Cómo se redacta en distintos estilos y tonos.

Más adelante, esos patrones se utilizan para generar respuestas nuevas, no para copiar textos exactos.

Si quieres ver cómo encaja este entrenamiento dentro del ciclo completo de la IA, lo detallamos aquí: Cómo funciona la inteligencia artificial.

4. Qué pueden hacer los LLM en la práctica

Un LLM bien entrenado y bien envuelto en una aplicación puede hacer muchas cosas útiles.

4.1 Generar y transformar texto

- Escribir borradores de artículos, emails y presentaciones.

- Resumir textos largos en puntos clave.

- Reescribir con otro tono (más formal, más cercano, más técnico…).

- Traducir entre idiomas manteniendo el contexto.

4.2 Ayudar a programar

- Generar fragmentos de código.

- Explicar errores y sugerir correcciones.

- Documentar funciones.

- Proponer tests y casos de prueba.

4.3 Funcionar como “profesor on demand”

- Explicar conceptos complejos con ejemplos.

- Adaptar la explicación al nivel del usuario.

- Generar ejercicios para practicar.

- Proponer analogías para entender mejor un tema.

4.4 Conversar y asistir

- Responder preguntas en un chat.

- Actuar como asistente de apoyo en trabajo o estudio.

- Guiar procesos (checklists, pasos, recomendaciones).

Todo esto lo ves en acción cuando usas un chat de inteligencia artificial. Si quieres la guía específica de chats:

Chat de inteligencia artificial: qué es y cómo usarlo bien.

5. LLM vs ChatGPT, Gemini y compañía: no es lo mismo

Aquí hay mucha confusión que va directo a SEO:

- LLM (modelo de lenguaje grande): es el modelo “crudo”, el cerebro matemático.

- ChatGPT, Gemini y otros chats: son productos que usan uno o varios LLM por debajo, con interfaz, reglas, filtros y extras.

Por eso es importante diferenciar:

- No “hablas con la IA” en abstracto: hablas con una combinación de modelo + producto + configuración.

- Dos apps distintas pueden usar el mismo modelo de base y comportarse de forma muy diferente.

Si quieres entender mejor esa capa de producto, lo explicamos en detalle aquí: ChatGPT y los modelos GPT: qué son y cómo funcionan.

6. Tamaño del modelo: por qué importa (pero no lo es todo)

Se llaman “grandes” por algo: los LLM tienen desde cientos de millones hasta cientos de miles de millones de parámetros.

En general:

- Más parámetros → más capacidad para aprender patrones complejos.

- Pero también → más coste de entrenamiento y uso, más consumo de memoria y energía.

En la práctica, hay un equilibrio:

- Modelos gigantes para tareas muy complejas o análisis profundo.

- Modelos más pequeños para tareas ligeras, integraciones móviles o trabajo on-device.

Si quieres ver cómo se traduce esto en costes reales, lo analizamos aquí: Coste real de los modelos de IA.

7. Límites de los LLM: en qué se rompen

Aunque impresionan, los LLM tienen límites claros que conviene tener muy presentes.

7.1 No “entienden” como un humano

Un LLM:

- No tiene conciencia ni experiencia propia.

- No sabe nada del mundo más allá de los patrones de texto que ha aprendido.

- No tiene acceso directo a la realidad, solo a representaciones lingüísticas.

Puede parecer que “razona”, pero lo que hace es encadenar patrones de forma muy sofisticada.

Si quieres ver la comparación más filosófica, lo desarrollamos aquí: IA vs inteligencia humana.

7.2 Se pueden inventar cosas (alucinaciones)

- Fabricar citas, referencias o números.

- Responder con seguridad sobre algo que no sabe.

- Mezclar datos reales con detalles inventados.

Por eso nunca deberían ser la única fuente de verdad en temas críticos (salud, legal, finanzas…).

7.3 Heredan sesgos de los datos

Si los datos de entrenamiento tienen sesgos (que los tienen), el modelo también:

- Estereotipos culturales.

- Visiones parciales de temas políticos o sociales.

- Diferencias en cómo trata a grupos distintos.

Esto lo analizamos con calma aquí: Riesgos y sesgos de la inteligencia artificial.

7.4 Privacidad y uso de datos

Con LLM en entorno profesional, el riesgo es meter:

- Datos de clientes.

- Información confidencial de la empresa.

- Datos personales sensibles.

En herramientas mal configuradas o sin garantías, esto puede chocar directamente con RGPD y el futuro AI Act.

Si trabajas en empresa, te interesa este análisis: Inteligencia artificial y privacidad en la empresa y la parte regulatoria aquí: Reglamento de IA en Europa y España.

8. Para qué te sirven los LLM a ti (no a “las empresas” en abstracto)

Más allá de la teoría, los LLM te sirven para:

- Acelerar tareas de lectura y escritura.

- Pensar alternativas y desbloquearte cuando estás atascado.

- Aprender temas nuevos con explicaciones adaptadas a tu nivel.

- Mejorar la calidad de tu comunicación (claridad, tono, estructura).

Y, si trabajas en empresa, para:

- Automatizar parte del soporte.

- Resumir documentación interna.

- Guiar procesos a empleados y clientes.

Si quieres ver aplicaciones organizadas por industria, lo tienes desglosado aquí: Aplicaciones de la IA por sectores.

Preguntas frecuentes sobre modelos de lenguaje grandes (LLM)

¿Un LLM es lo mismo que un chat de IA?

No. El LLM es el modelo de lenguaje que genera el texto. El chat es la aplicación que lo envuelve, con interfaz, reglas, memoria de conversación y a veces acceso a herramientas externas.

¿Cuáles son los mejores LLM ahora mismo?

Depende de la tarea (texto general, código, multilingüe, etc.). Mantenemos un ranking explicado en lenguaje humano aquí: Ranking de modelos de IA para texto.

¿Los LLM entienden lo que dicen?

No en el sentido humano. Trabajan con patrones estadísticos, no con comprensión consciente. Aun así, su comportamiento puede parecer muy “listo” en muchas tareas.

¿Puedo entrenar mi propio LLM desde cero?

Técnicamente sí, pero en la práctica entrenar un LLM grande desde cero está al alcance de muy pocas organizaciones. Lo habitual es usar modelos existentes (cerrados u open-source) y adaptarlos.

¿Necesito un LLM gigante para mi proyecto?

No siempre. Muchas aplicaciones funcionan mejor y más barato con modelos medianos o pequeños bien configurados. Lo importante es elegir el modelo adecuado para la tarea y el contexto.